Psychology of China

AI情绪识别在幼小教育的创新应用趋势与优化策略

The innovative application trend and optimization strategy of AI emotion recognition in early childhood education

-

Information:

苏州科技大学,苏州

-

Keywords:

AI emotion recognition; Early childhood education; Multimodal recognition; Education ethicsAI情绪识别; 幼小教育; 多模态识别; 教育伦理

- Abstract: Emotion is a key factor affecting children ‘s learning motivation, classroom participation and social development. With the acceleration of education digitization, the application of AI emotion recognition technology in kindergarten and primary school classrooms has gradually attracted attention. However, due to the instability of children ‘s emotional expression, complex classroom environment, model deviation and privacy risk, technology still faces obvious limitations in the process of landing. This paper systematically combs the development trend of AI emotion recognition from single mode to multi-mode, summarizes its main application methods in classroom observation, learning support and special children ‘s education, and deeply analyzes the ethical issues such as recognition error, emotion tagging and data security. On this basis, the technology optimization, scene adaptation and governance strategies for early childhood education are proposed. It aims to provide theoretical basis and practical reference for the more scientific and prudent use of emotion recognition technology in the process of promoting education digitization in the field of early childhood education in China. 情绪是影响幼儿学习动机、课堂参与和社会性发展的关键因素。随着教育数字化进程加速,AI情绪识别技术在幼儿园和小学课堂中的应用逐渐受到关注。但由于儿童情绪表达不稳定、课堂环境复杂、模型偏差与隐私风险突出,技术在落地过程中仍面临明显限制。本文系统梳理AI情绪识别从单模态到多模态的发展趋势,结合幼小教育场景,总结其在课堂观察、学习支持与特殊儿童教育中的主要应用方式,并深入分析识别误差、情绪标签化、数据安全等伦理问题。在此基础上,提出面向幼小教育的技术优化、场景适配与治理策略。旨在为我国幼小教育领域在推进教育数字化过程中更科学、审慎地使用情绪识别技术提供理论依据与实践参考。

- DOI: 10.35534/pc.0803065

- Cite: 郑婷, 陆丽伟, 赵淑桢, 陈翠. (2026). AI情绪识别在幼小教育的创新应用趋势与优化策略. 中国心理学前沿, 8 (3), 418-425.

1 引言

情绪是儿童学习活动中的基础性心理机制,直接影响注意力维持、任务投入、学习成效和同伴互动。《3~6岁儿童学习与发展指南》对儿童的情绪能力提出了明确要求:“学会恰当表达和调控情绪”“用律动或简单的舞蹈动作表现自己的情绪”等。在幼小课堂中,教师通常依赖日常经验观察获取儿童情绪状态,但事实上,这一工作面临困难:其一,幼小儿童情绪外显、强度低、不稳定;其二,情绪表达高度情境化,同一行为在不同儿童身上可能对应不同情绪含义;其三,班级规模较大,课堂节奏限制教师持续进行细致、个别化的观察,因此教师准确识别儿童情绪的难度较高。

随着人工智能(AI)特别是深度学习技术的发展,情绪识别技术逐渐具备对面部表情、语音语调甚至生理信号进行自动分析的能力,为教师提供一种新的“第三只眼睛”这一技术在教学中的潜力,尤其是对个性化教学、学习动机提升和学生情感支持的可能性,越来越受到关注。2025年1月,中央、国务院正式印发《教育强国建设规划纲要(2024—2035年)》,明确将“教育数字化”“人工智能助力教育变革”纳入国家教育战略,推动教学方式革新、教师素养提升、智慧校园建设等。教育部部长怀进鹏在讲话中提出建设国家教育数字化,探索数字赋能大规模因材施教、创新性教学的有效途径。然而,科技也是一把双刃剑,AI情绪识别技术在幼小课堂中的应用仍面临诸多挑战,一方面,它为教师提供了一个理解学生情绪状态的全新视角;另一方面,算法偏见、隐私漏洞、教师角色边缘化、儿童权利弱化等的伦理风险纷至沓来。因此,情绪识别技术的三个关键问题应运而生:该技术如何适配幼小教育?其教育价值是什么?伦理风险如何治理?基于此,本文将在系统梳理当前主流的AI情绪识别技术的基础上,分析其应用于幼小课堂的实践与价值,并进一步探讨其伦理风险与未来发展方向。

2 AI情绪识别技术在幼小教育中的应用与适配挑战

2.1 技术演进概述与教育应用转向

情绪识别技术作为教育人工智能领域的重要组成部分,近年来经历了显著的理论发展与技术演进(D’mello & Kory,2015)。从早期依赖手工特征的传统方法,到当前基于深度学习的多模态融合模型,情绪识别技术在算法架构与识别效能上均取得了重要进展(Barrett et al.,2019)。不论是在面部情绪识别方面还是在语音情绪识别方面,分析单一模态都存在着显著的制约因素和现实问题,为了克服单一模态的局限性,多模态融合逐渐成为技术发展的主流方向,通过整合综合分析面部、语音及行为等多源信息,实现对情绪状态的智能化识别与判断,提升情绪判断的准确性(Qu et al.,2023)。通过不断地发展和演进,该项技术也逐渐转向幼小教育应用场景,展现出独特的应用价值,被视为辅助教育工作者实施情感教育、优化课堂管理以及支持学生心理健康发展的有效工具。

2.2 在幼小教育场景中的应用与挑战

AI情绪识别技术在幼小教育阶段具有广泛的应用前景和实际价值,展现出多维度应用潜力。一是在教师支持方面,该系统可辅助课堂观察与情绪监测,通过实时分析学生表情与行为数据,帮助教师及时识别情绪波动与注意力变化,进而为个性化教学提供决策依据(Zhang et al.,2024)。二是在学生支持方面,该技术可提供情感陪伴功能,通过识别学习过程中的情绪变化辅助调节学习状态,同时基于情绪数据预测学情趋势,并有针对性地提升学习动机(Barrett et al.,2019)。三是在特殊儿童教育支持方面,情绪识别系统可为自闭症及语言障碍儿童提供辅助,通过多模态数据分析其非语言情绪表达,帮助教育者更准确地理解其情感需求与沟通意图(Berggren et al.,2018)。

AI情绪识别技术虽在幼小教育场景中有巨大的应用前景,但也面临多方面的适配性挑战。首先,儿童情绪表达具有明显的年龄特征,幼儿的情绪表现往往较为外显且变化迅速,同时伴随着丰富的肢体语言,而小学阶段学生的情绪表达则逐渐内化,可能出现外部表现与内心体验不一致的情况(Barrett et al.,2019)。这种发展性差异对识别系统的准确性和适应性提出了更高要求。当前大多数情绪识别模型基于成人数据训练,其在儿童群体中的应用效果存在局限性。其次,教育场景本身的复杂性也是一个重要挑战,课堂环境中的情绪表达往往与具体的教学情境、师生互动和同伴关系密切相关。现有的情绪识别系统通常缺乏对教育场景特殊性的充分考虑,难以准确区分学生在不同学习状态下的情绪表现。此外,数据隐私保护、伦理规范遵循以及技术应用的教育适宜性等问题也需要严肃对待(Z. Li et al.,2025)。如何在保护儿童隐私的前提下获取有效的情绪数据,如何确保技术应用的透明性和可解释性以及如何避免技术应用可能带来的标签化效应,这些都是需要深入研究和妥善解决的重要问题。

3 AI情绪识别在幼小课堂教学中的实践与价值

3.1 教师支持:课堂观察、情绪监测、个性化教学

AI情绪识别技术能够实时监控学生的情绪变化,从而帮助教师根据情绪反馈调整教学策略,优化课堂互动,并为课堂管理和个性化教学提供有效支持。

在幼小课堂中,课堂观察首先需要回答三个问题:观察谁、观察什么、观察后用于何种教学决策。观察内容不宜被简化为情绪类别本身,而应指向与学习过程相关的行为,例如注意力维持、任务投入、互动意愿等,为教师支持提供情绪线索。在此意义上,AI情绪识别为教师提供“第三只眼睛”,即通过技术手段延伸教师的观察能力,把原本难以持续记录的课堂状态转化为可追踪且可汇总的情绪线索。现有应用中,廖宇森等人(2025)提出基于Yolov5的课堂学生学习情绪面部特征识别算法,将学生学习注意力、学习兴趣、知识点掌握程度等量化,为课堂观察与评价反馈提供技术支撑。同时,考虑到幼小阶段儿童情绪外显往往呈现强度低、不稳定的特点,Wang和Dong(2025)提出基于注意力增强卷积神经网络(AFCNN)的儿童情绪识别模型,提高了儿童微表情识别的准确率,为课堂观察提供更加可靠的面部情绪线索。但需要强调的是,儿童情绪具有高度情境性,对其情绪的界定需算法结合教师对具体情境的专业理解的共同解释。

相较于单次的情绪识别,课堂情境更需要持续的情绪监测,即在课堂活动过程中捕捉情绪变化趋势、预测可能情境等。因此,多模态情绪监测系统能结合面部表情、语音和生理信号,实时监测学生的情绪波动,帮助教师了解学生的情绪状态并即时作出反映。Huang等人(2024)改进了YOLOv8模型,使其在复杂小学课堂环境中实现对面部表情、骨骼结构和背景的多通道情绪监测,更快更准确识别情绪。许萌与韩鹏(2023)研究得出基于多模态融合设计的情感识别模型,能得到更高精度的情绪识别结果,且能够用于实际的学前教育过程的儿童情感识别中,进一步提升教学效果。然而,课堂环境复杂多变,幼小儿童的情绪波动易受同伴互动、任务难度等多重因素影响,因此情绪监测结果在教学解释与使用层面仍面临挑战。

在个性化教学层面,教师真正需要的是可执行的教学策略支持,而非系统判定学生情绪。因此,情绪识别技术的价值在于辅助教师识别学生情绪状态和学习进度,为其提供个性化的学习支持和情感关怀,确保每个学生的学习需求得到满足。Choksi 等人(2024)设计开发的SensEmo智能手表能实时识别学生的情绪状态并反馈给教师,且能分析不同学习阶段学生的情绪变化,为幼小个性化教学提供可能。Wang等人(2022)基于YOLOv5模型的多学生情绪识别系统,能够在智能课堂中实时分析学生的情绪状态,并根据情绪变化调整教学设计。但同时,教师应注意防范对技术的过度依赖和对儿童主体性的忽视。

3.2 学生支持:情绪陪伴、学情预测、学习动机提升

AI情绪识别技术不仅能帮助教师,还能为学生提供持续的学习支持机制。一方面,通过情感交互与陪伴缓解学习压力,增强学生安全感;另一方面,将情绪状态作为学习过程性指标,理解并预测学习表现,给予针对性的支持和干预,从而提升学习动机与学习效果。

在幼小阶段,学生的情绪表达往往与具体生活事件、同伴互动和课堂情境紧密相关。Seo等人(2024)在CHI会议上提出的ChaCha聊天机器人基于大语言模型(LLM),通过开发式对话与话题引导,鼓励8至12岁儿童分享与具体经历(如家庭旅行、同伴矛盾)相联的情绪,并在情境交互过程中提供情感陪伴。

AI情绪识别技术在教育中的核心价值在于将情绪数据转化为教学反馈。近年来,我国教育政策逐步强调基础教育过程中过程性评价的重要性,而淡化结果性评价,这一转向体现了对学生成长过程的全面关注。AI情绪识别技术通过将情绪状态纳入学习分析,有助于更准确地预测学生学习状态并提供细致的解释与评价。Kutaka等人(2025)基于自动面部情绪识别技术,对幼儿在算术学习任务中的情绪进行连续测量,并以解题正确率作为即时学情指标,发现幼儿的情绪特征与其学习表现之间存在显著关联,这表明情绪信息能够在一定程度上用于解释和预测学习结果。此外,Choksi等人(2024)提出的SensEmo智能手表能实时识别学习者的情绪与注意力状态,并预测学习参与度和学习表现。但需要注意的是,情绪作为“过程性指标”在教育中的应用必须慎重,教师应避免将学生的情绪波动直接等同于其能力,而要结合具体教学情境具体

分析。

对于幼小阶段的儿童而言,其学习动机高度受情绪影响,若系统能够在识别到困惑、焦虑等情绪后提供调节建议与支持,则更可能增强其学习动机,形成可持续投入的学习体验。已有研究团队提出情绪脑电网络低维判别流行表征模型(L1-SGL),并由此开发个体情绪在线解码与反馈系统,通过“识别—反馈—调节”的实时闭环引导使用者自主调节情绪,以此促进学习者的学习动机和效果(C. Li et al.,2025)。此外,Li(2025)提出的情绪监测与干预框架通过融合多模态数据,实时检测学生的学习情绪,并根据情绪变化提供相应的个性化教学策略,从而提升学生的学习效率和课堂体验。Goyal团队开发的MindLift系统将情绪识别与认知行为疗法(CBT)相结合,为学生提供个性化的情绪调节支持,帮助学生缓解焦虑等负面情绪,提升学习动机(Goyal et al.,2025)。

3.3 特殊儿童支持:自闭症、语言障碍儿童的情绪识别辅助

对于自闭症谱系障碍(ASD)和发育性语言障碍(DLD)儿童而言,传统课堂互动往往受限于情感表达困难、非语言线索解读不足以及交流负担重等因素,AI情绪识别技术对提升其情感识别与社交能力具有重要的作用。通过个性化的情绪辅助应用,AI为这些特殊儿童降低表达门槛,搭建情绪支架,从而提升其情绪理解、表达与社交能力。

发育性语言障碍儿童在理解与表达情绪时常受语言能力的限制,因此情绪识别技术借助情境理解儿童情绪,为教师进行后续社交沟通训练提供更为明确的观察依据。Lloyd-Esenkaya等人(2024)开发的“Zoti’s Social Toolkit”以动画叙事呈现中性外星人“Zoti”在人际情境中的故事,引导儿童依靠非语言线索(如面部表情、肢体语言和场景线索)识别情绪,这极大地降低了对儿童自身语言能力的依赖。

面向自闭症儿童的教育支持中,情感识别技术的应用可概括为三类,其一是能力训练型,通过情境化练习提升情绪识别与表达;其二是课堂交互评估型,对互动中情绪维持与调节进行量化观察;其三是学习支持型,情绪识别结果作为自适应学习系统的过程性信号,参与教学决策,例如可以进行提示推送、难度调节、节奏调整,以支持学习过程的持续管理。

在能力训练层面,Tang 等人(2024)开发的生成式AI情感学习辅助工具EmoEden,面向高功能自闭症(HFA)儿童,通过动态生成个性化对话和视觉内容,为其提供沉浸式、情境化的情绪理解和表达练习。该研究发现 EmoEden 能够有效吸引儿童参与,并显著提高他们的情绪识别能力和情绪表达能力。类似地,Chitti等人(2025)构建的多模态情绪识别平台将exergame(运动游戏)与多模态反馈结合,通过多种感官刺激建立互动情境,从而帮助儿童识别基本情绪(如快乐、愤怒、恐惧和悲伤)并逐步过渡到复杂情绪的辨识,提升其情绪识别与理解能力。

在课堂交互评估层面,情绪识别技术的价值在于把难以持续记录的互动表现转化为可追踪的观察线索,帮助教师更有针对性地调整教学支持方式。Lorenzo 和 Lorenzo-Lledó(2024)基于NAO社交机器人构建了自动情绪识别系统,对学前阶段自闭症儿童在课堂互动中的情绪持续时间进行量化分析,从而揭示不同教学活动对情绪维持与调节的影响,为个别化教学与情绪支持提供数据依据。

在学习支持层面,Ruan等人(2023)开发的“Meta-BrainHood”智能辅导系统集成AI情绪识别算法以实时检测学习过程中的认知情绪状态(如沮丧、焦虑),并基于识别结果,对儿童元认知监测状态进行推断,进而为儿童提供如调整题目难度、提供提示等的自适应学习支持,辅助儿童优化学习策略并调整学习过程。

AI情绪识别技术在自闭症谱系障碍和发育性语言障碍儿童的教育中展现了巨大的应用潜力。通过为这些特殊儿童提供个性化的情绪支持,AI技术不仅帮助降低了情绪表达的门槛,还有效提升了他们的情绪理解与社交能力。从能力训练到课堂互动评估,再到学习支持,AI情绪识别技术已经逐渐覆盖了特殊儿童教育的多个方面。尽管如此,情绪识别技术的应用也仍需进一步完善与发展,未来,AI情绪识别系统应考虑到不同儿童的个性化需求和认知特征,帮助教育工作者“看见”每一个孩子。

4 伦理风险与反思

4.1 AI情绪识别的技术风险

在AI情绪识别技术逐渐广泛应用的同时,它在教育领域的技术风险也愈发明显,包括算法偏见,数据、隐私安全等。

算法偏见指的是系统中可能出现的“任何系统性错误”(Booth et al.,2021)。McStay(2020)指出,算法背后的数据标准通常来源于西方,导致其在处理非西方国家的个体是易产生偏差。特别在面部表情识别方面,已有多项研究表明,对学生情绪的识别因文化、情境和个体因素(如性别、年龄)而有很大差异(Salloum et al.,2025);(Parraga et al.,2025)。这种算法数据偏见会延续至情感挖掘系统中,从而削弱公平性(Denecke & Gabarron,2024)。

数据、隐私安全问题日益受到关注,Holmes(2019)指出,当情绪识别系统用于课堂实时监测时,容易导致教学行为“数据化”和“监控化”,模糊学生隐私和教学反馈界限。Banzon等人(2023)建议,收集学生面部数据需要深入考虑数据安全和隐私问题,以保护其隐私。

目前,许多现有系统采用“黑箱式算法”,这使得人们无法了解这些系统如何解读情绪,使用哪些数据以及是否存在偏见(Hazmoune & Bougamouza,2024),这种不透明性进一步加剧了教育应用中的伦理风险。

4.2 AI情绪识别的教学风险

AI情绪识别技术的课堂应用虽改善了教学互动和学生情感支持,但也随之对学生自主性、教师职业角色和教育公平等带来风险。

Banzon等(2023)指出,在将情绪识别应用于监测学生参与度,不利于尊重其自主性,且窄化了成功的衡量标准。此外,长期追踪学生情绪可能导致其自主性丧失,引发污名化和情感恐吓等负面后果(Cartwright et al.,2024)。人工智能通过类人方式参与情感互动,会导致使用者产生情感依赖(Elyoseph et al.,2024),这种依赖将影响人类的自主情感发展,进而影响身心健康。还有研究表明,在教育资源相对薄弱地区的学校中,若在使用机器人和AI工具时未充分考虑不同文化背景(如口音)与教育资源的差异,将会加剧“数据鸿沟”(Singh et al.,2023)。

赵丹丹(2022)指出,技术开发者的教育伦理认知与技术应用者的人工智能伦理素养的不足是导致人工智能教育应用伦理困境的问题之一。人工智能技术对教育活动的过度介入将使教师角色边缘化,诱发教师的职业焦虑,职业认同感降低(吉峰,2025),从而影响教育质量和师生关系的建立。

4.3 AI情绪识别外部环境风险

当前,人工智能教育应用缺乏针对性的法律条文和专业的监管体系,是人工智能教育应用中的一大伦理风险。此外,Gouseti等人指出,当AI情绪识别技术出错或被误用时,责任归属不清(Gouseti et al.,2025),缺乏有效的追责制度,也会引发一系列问题。

4.4 AI情绪识别伦理风险的总结与反思

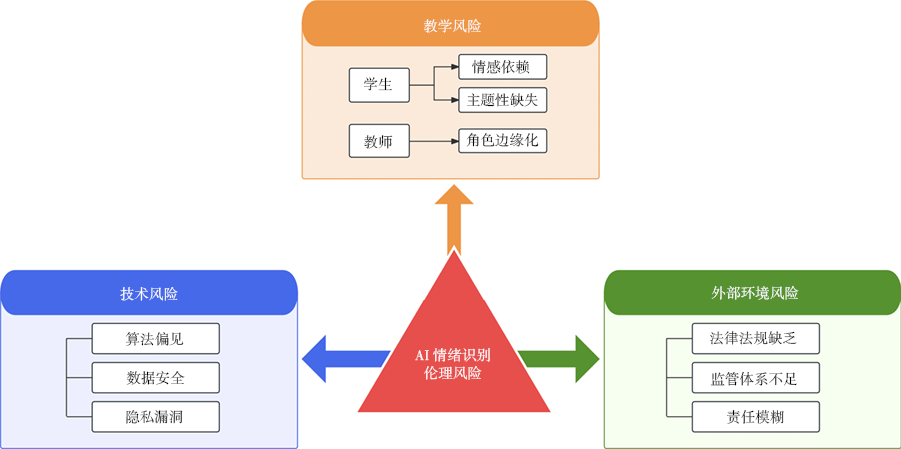

AI情绪识别在教育中的应用所带来的伦理风险,主要来自技术、教学和外部环境三个方面,如图1所示。在技术层面,探讨了算法偏见,数据安全和隐私漏洞等问题,为促进教育公平提供了反思方向。在教学层面,分析了学生、教师以及技术开发者各自面临的风险,强化育人为本的教学理念。在外部环境层面,讨论了制度监管不足以及责任模糊等问题,突出完善制度和增强监管的必要性。

面对上述AI情绪识别伦理风险,教师应首先树立以人为本的教育理念,让技术和智能服务于人类;确保技术向善,强化自身人工智能伦理素养;推动实现技术透明化,打破“黑箱算法”,合理使用教育数据,保障学生的自主选择权。

图 1 AI情绪识别伦理风险模型图

Figure 1 Ethical risk model of ai emotional recognition

5 优化策略

5.1 面向教师支持的优化策略

在教师支持场景中,优化重点是将AI情绪识别技术的应用从单一的判定情绪类别转向为教师提供教学线索。幼小课堂中的情绪观察应结合注意力维持、任务投入、互动意愿等与学习过程相关的表现及其变化趋势,以降低情绪标签化与误判带来的固化印象。

针对算法偏见与文化差异导致的识别偏差,未来可推动构建面向儿童的多模态情绪数据资源,并在年龄、文化背景、性别及特殊教育需要等维度上提升样本多样性,以减少系统性偏差;同时,使用者应结合课堂活动、师生互动及个体学习模式,对AI提供的情绪信息进行理解(Xie et al.,2025)。针对“黑箱式算法”的不透明性,未来系统应整合可解释人工智能(XAI)技术,为教师提供可视化的判定依据和置信度说明,如呈现支撑“困惑”情绪判定的面部区域或语音特征(Mohammadi et al.,2025)。这不仅能帮助教师理解AI的推论过程,也能在出现误判时由教师进行人工复核与纠正,形成“人机协同”的决策模式。

个性化教学层面,教育机构在引入情绪识别系统前应明确其定位在于辅助工具,而非评判权威,以防范过度依赖技术导致的教师角色边缘化和师生关系的削弱。

5.2 面向学生支持的优化策略

在学生支持的场景中,优化策略的核心在于降低情绪操纵、标签化与自主性丧失等风险,优先将情绪识别用于支持表达与学习,而非监控与评判。

情绪陪伴功能应避免将目标设定为纠正、塑造情绪,而应该帮助儿童理解、表达与调节情绪,从而减少情绪操纵与不良心理的影响。学情预测可为学生的过程性评价提供依据,但必须防止把情绪波动等同于能力不足或学习态度问题;预测结果应服务于教师的教学支持与沟通,而非对学生做标签化分类。学习动机提升方面,宜采取低侵入式的教学方式,并为儿童提供可选择的调节建议与学习支架,避免长期追踪带来的自主性丧失、情感恐吓等后果。

5.3 面向特殊儿童支持的优化策略

用于支持自闭症与语言障碍儿童的技术设计应充分考虑其情绪表达与非语言线索解读的差异,避免将成人或普通儿童模型简单迁移。对于语言障碍儿童可更多依赖肢体动作、表情、情境等非语言线索降低表达负担。对于自闭症儿童,情绪识别结果可在能力训练、课堂交互评估与学习支持等方面提供支持,帮助教师结合课堂观察更好地满足儿童个别化的教育需要。

5.4 外部环境保障的优化策略

为确保数据安全和防范隐私风险,学校在引入技术时应完善伦理流程,明确告知学生和家长数据收集的范围、用途、存储期限及权利,取得他们的同意,并提供退出与撤回路径。针对责任模糊问题,应建立清晰的责任框架,规定技术提供方承担系统性能与安全要求,学校管理者负责制度与监督,教师负责课堂使用与人工判断。同时,需严格限制技术的使用场景,避免将情绪数据用于惩戒、排名等,而应聚焦于课堂情感反馈与教学调整。

6 结语与未来展望

没有对幼小课堂情绪规律的科学把握和配套实践支撑,AI情绪识别的教育应用就难以真正落地。随着深度学习等技术的发展,情绪识别为教师提供了新的观察视角,也为过程性支持与个性化教学带来新的可能,但幼小课堂的复杂性决定了这一技术不能停留在“识别更准”的单一目标上。面对幼小阶段儿童情绪表达弱、持续时间短、情境依赖强等特点,本文从教师支持、学生支持与特殊儿童支持三个主题出发,梳理了AI情绪识别在幼小教育中的实践价值,并从技术、教学与外部环境三个层面揭示其风险结构。研究表明,算法偏见、数据与隐私安全、“黑箱式算法”等技术问题,容易导致学生自主性弱化与教师角色边缘化等教学风险,而制度规范与责任边界的不完善又进一步放大了风险的不确定性。

展望未来,AI情绪识别技术在幼小教育中的应用还需要在真实课堂中不断验证和调整。首先,很多结论仍应回到课堂情境中检验,以验证情绪识别在不同活动环节下的稳定性,并归纳其常见误判类型,以避免对儿童的标签化判断。其次,面向幼小群体的适配仍是关键,需构建更符合儿童表达特点的本土化数据模型,并平衡其可用性与公平性。最后,学校层面的使用规范也需要同步完善,例如告知同意、用途、退出路径和责任分工等,保障技术应用在出现问题时也有可追溯路径。总体而言,AI情绪识别能否产生稳定成效,关键不在技术叠加,而在于在以人为本的育人理念下,为教师提供更及时、可理解的情绪支持线索。只有当技术能力、教学实践与制度环境形成协同育人,才能真正服务于幼小教育的高质量发展。

参考文献

[1] 吉峰. (2025). 教育人工智能技术的伦理省思与纾解. 重庆邮电大学学报(社会科学版), 37(5), 149-157.

[2] 廖雨森, 马旭, 柯钧, 薛正辉, 刘媛. (2025). 基于学习情绪面部特征识别的课堂教学智慧评价方法. 北京理工大学学报, 45(6), 609-620.

[3] 许萌, 韩鹏. (2023). 面向学前教育对话机器人的多模态情感识别实现关键技术. 自动化与仪器仪表, (9), 137-141.

[4] 赵丹丹. (2022). 人工智能教育应用的伦理审视 (硕士研究生) . 山东师范大学.

[5] Banzon A M, Beever J & Taub M. (2023). Facial expression recognition in classrooms: Ethical considerations and proposed guidelines for affect detection in educational settings. IEEE Transactions on Affective Computing, 15(1), 93-104.

[6] Barrett L F, Adolphs R, Marsella S, Martinez A M & Pollak S D J P s i t p i. (2019). Emotional expressions reconsidered: Challenges to inferring emotion from human facial movements. 20(1), 1-68.

[7] Berggren S, Fletcher-Watson S, Milenkovic N, Marschik P B, Bölte S & Jonsson U J D n. (2018). Emotion recognition training in autism spectrum disorder: A systematic review of challenges related to generalizability. 21(3), 141-154.

[8] Booth B M, Hickman L, Subburaj S K, Tay L, Woo S E & D’Mello S K. (2021). Integrating psychometrics and computing perspectives on bias and fairness in affective computing: A case study of automated video interviews. IEEE Signal Processing Magazine, 38(6), 84-95.

[9] Cartwright J, Ellington M T & Hawthorne A S. (2024). Exploring the potential of emotional intelligence in AI through emotion-sensitive learning algorithms. Preprint. from https://www. researchgate. net/publication/378288861 (accessed on 24 March 2025).

[10] Chitti E, Actis-Grosso R, Ricciardelli P, Olivari B, Carenzi C, Tedoldi M & Borghese N A. (2025). MiEmo: A multi-modal platform on emotion recognition for children with autism spectrum condition. Computers in Human Behavior Reports, 17, 100549.

[11] Choksi K, Chen H, Joshi K, Jade S, Nirjon S & Lin S. (2024). SensEmo: Enabling affective learning through real-time emotion recognition with smartwatches. 2024 IEEE 21st International Conference on Mobile Ad-Hoc and Smart Systems (MASS),

[12] D’mello S K & Kory J J A c s. (2015). A review and meta-analysis of multimodal affect detection systems. 47(3), 1-36.

[13] Denecke K & Gabarron E. (2024). The ethical aspects of integrating sentiment and emotion analysis in chatbots for depression intervention. Frontiers in Psychiatry, 15, 1462083.

[14] Elyoseph Z, Hadar Shoval D & Levkovich I. (2024). Beyond personhood: ethical paradigms in the generative artificial intelligence era. The American Journal of Bioethics, 24(1), 57-59.

[15] Gouseti A, James F, Fallin L & Burden K. (2025). The ethics of using AI in K-12 education: A systematic literature review. Technology, Pedagogy and Education, 34(2), 161-182.

[16] Goyal S, Dutta R, Dev S, Raju K N & Bhatt M W. (2025). MindLift: AI-Powered Mental Health Assessment for Students. Neuroscience Informatics, 100208.

[17] Hazmoune S & Bougamouza F. (2024). Using transformers for multimodal emotion recognition: Taxonomies and state of the art review. Engineering Applications of Artificial Intelligence, 133, 108339.

[18] Holmes W, Bialik M & Fadel C. (2019). Artificial intelligence in education promises and implications for teaching and learning. Center for Curriculum Redesign.

[19] Huang Y, Deng W & Xu T. (2024). A Study of Potential Applications of Student Emotion Recognition in Primary and Secondary Classrooms. Applied Sciences (2076-3417), 14(23).

[20] Kutaka T S, Chernyavskiy P & Hofkens T. (2025). Achievement emotions in kindergarten: the association of solution accuracy with discrete joy, sadness, and surprise. Frontiers in Psychology, 15, 1466345.

[21] Li C, Cao Z, Pan Y, Zhu P, Li P, Li F, Chen H, Lu B L, Wan F & Yao D. (2025). EEG-based emotion monitoring and regulation system by learning the discriminative brain network manifold. IEEE transactions on neural networks and learning systems.

[22] Li J. (2025). Multimodal emotion recognition in children’s online learning: Emotion monitoring and intervention strategy design. Edelweiss Applied Science and Technology, 9(7), 1482-1495.

[23] Li Z, Zheng W L & Lu B L. (2025). Multimodal Emotion Recognition with Missing Modality via a Unified Multi-task Pre-training Framework. Proceedings of the 33rd ACM International Conference on Multimedia.

[24] Lloyd-Esenkaya V, Russell A J & St Clair M C. (2024). Zoti’s Social Toolkit: Developing and piloting novel animated tasks to assess emotional understanding and conflict resolution skills in childhood. British Journal of Developmental Psychology, 42(2), 187-214.

[25] Lorenzo G & Lorenzo-Lledó A. (2024). The use of artificial intelligence for detecting the duration of autistic students’ emotions in social interaction with the NAO robot: a case study. International Journal of Information Technology, 16(2), 625-631.

[26] McStay A. (2020). Emotional AI and EdTech: serving the public good? Learning, Media and Technology, 45(3), 270-283.

[27] Mohammadi M, Tajik E, Martinez-Maldonado R, Sadiq S, Tomaszewski W, Khosravi H J C & Intelligence E A. (2025). Artificial intelligence in multimodal learning analytics: a systematic literature review. 100426.

[28] Parraga O, More M D, Oliveira C M, Gavenski N S, Kupssinskü L S, Medronha A…Barros R C. (2025). Fairness in Deep Learning: A survey on vision and language research. ACM Computing Surveys, 57(6), 1-40.

[29] Qu L, Li T, Weber C, Pekarek-Rosin T, Ren F, Wermter S J I A T o A, Speech & Processing L. (2023). Disentangling prosody representations with unsupervised speech reconstruction. 32, 39-54.

[30] Ruan X, Palansuriya C, Constantin A & Tsiakas K. (2023). Supporting Children’s Metacognition with a Facial Emotion Recognition based Intelligent Tutor System. Proceedings of the 22nd Annual ACM Interaction Design and Children Conference,

[31] Salloum S A, Alomari K M, Alfaisal A M, Aljanada R A & Basiouni A. (2025). Emotion recognition for enhanced learning: using AI to detect students’ emotions and adjust teaching methods. Smart Learning Environments, 12(1), 21.

[32] Seo W, Yang C & Kim Y H. (2024). Chacha: leveraging large language models to prompt children to share their emotions about personal events. Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems.

[33] Singh D K, Kumar M, Fosch-Villaronga E, Singh D & Shukla J. (2023). Ethical considerations from child-robot interactions in under-resourced communities. International Journal of Social Robotics, 15(12), 2055-2071.

[34] Tang Y, Chen L, Chen Z, Chen W, Cai Y, Du Y… Sun L. (2024). Emoeden: Applying generative artificial intelligence to emotional learning for children with high-function autism. Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems,

[35] Wang F & Dong J. (2025). The application of improved AFCNN model for children’s psychological emotion recognition. Scientific Reports, 15(1), 24138.

[36] Wang Z, Yao J, Zeng C, Wu W, Xu H & Yang Y. (2022). Yolov5 enhanced learning behavior recognition and analysis in smart classroom with multiple students. 2022 International Conference on Intelligent Education and Intelligent Research (IEIR),

[37] Xie Y, Yang L, Zhang M, Chen S & Li J. (2025). A Review of Multimodal Interaction in Remote Education: Technologies, Applications, and Challenges. Applied Sciences, 15(7), 3937.

[38]Zhang X,Zhu F,Wang K,Cao G,Xue Y & Liu M.(2024). Bring the Intelligent Tutoring Robots to Education:A Systematic Literature Review. IEEE Transactions on Learning Technologies,1-21.